一边是深度学习碰壁的呐喊,一边是马上就能造出人形AI的喜悦深度学习三巨头之一的Yann LeCun终于坐不住了

当地时间6月16日,Yann LeCun撰写了《人工智能能告诉我们什么》,首次正面回应了深度学习目前存在的问题勒村写道,从一开始,批评者就过早地认为神经网络遇到了不可逾越的墙,但每次都被证明只是暂时的障碍

LeCun认为,这是一场关于深度学习前景的争论争论的核心是关于符号在智能中的作用有两种不同的观点:一种是符号推理必须从一开始就硬编码,另一种是机器可以像人类一样从经验中学习这就涉及到我们应该如何理解人类的智能,然后去追求人类级别的人工智能

为世界首富马斯克准备了50万美元的奖金池。

2012年,Geoffrey Hinton领导的团队赢得了ImageNET大规模视觉识别挑战赛此后,深度学习成为人工智能研究的主要焦点

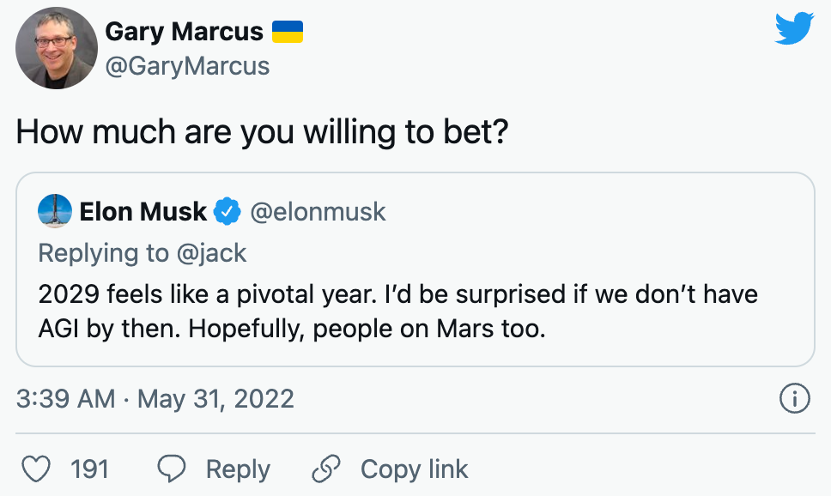

深度学习在许多曾经挑战计算机的任务中取得了进展,包括图像分类,物体检测,语音识别和自然语言处理它的表现甚至让人觉得人形特工的诞生指日可待埃隆马斯克在推特上表示,2029年感觉像是关键的一年如果那时我们没有AGI,我会很惊讶我希望火星上的人也一样

2029年,AI看不懂电影,不能准确告诉你发生了什么,

2029年,AI无法阅读小说,无法可靠地回答关于情节,人物,冲突,动机等问题。

2029年,AI在任何厨房都做不了称职的厨师,

2029年,AI无法通过自然语言规范或与非专家用户的交互,可靠地构建超过10000行的无错代码,

2029年,AI无法从用自然语言编写的数学文献中任意获取证据,并将其转换为适合符号验证的符号形式。

这是我的建议如果你能在2029年完成至少三项,就算你赢了10万美元怎么样马库斯写道

马库斯发出这条推文后的几个小时内,他发布赌博游戏的网站就有近1万次页面浏览量,奖金池现在已经增加到50万美元,由作家凯文·凯利提出在其网站上托管但是马斯克没有回应

对马库斯·马斯克说,比如你在2015年说要两年才能实现完全自动驾驶的汽车从那以后,你几乎每年都会说同样的话,但现在完全自动驾驶还没有实现

马库斯一直对深度学习的技术路径持怀疑态度他曾经写过一本关于深度学习局限性的书,他支持结合不同人工智能技术的混合方法3月中旬,马库斯曾撰文《深度学习碰壁》,认为纯粹的端到端深度学习即将结束,整个AI领域必须另寻出路

混合方法VS纯深度学习:马库斯窒息辛顿

终于在6月1日,一向深居简出的杰弗里·辛顿在加州伯克利教授彼得·阿比尔的播客节目中谈到了这个话题如果有人说他们碰壁了,那么他们只需要列出深度学习做不到的事情五年后,我们可以证明深度学习做到了

因此,Marcus在Twitter上写了一封公开信给Geoffrey Hinton,并提到了判断AGI的五个标准,这是他与Ernest Davis合作编写的意味着他在和马斯克的对赌中,把深度学习做不到的事情都列出来了

深度学习的缺点确实伴随着发展越来越清晰,包括其有限的泛化能力,与因果关系的斗争以及缺乏可解释性此外,大多数深度学习应用需要大量人工标注的训练样本,这也成为一个瓶颈但在Geoffrey Hinton,Yoshua Bengio和Yann LeCun这三位因对深度学习的开创性贡献而闻名的图灵奖获得者看来,一个更好的神经网络架构最终会克服当前深度学习的局限性

实际上,LeCun在5月份也发了推文,我相信我们需要找到新的概念,以便机器能够:通过像婴儿一样观察来理解世界是如何运转的学习如何通过行动来影响世界但这里说的和马尔库斯主张的不是一回事LeCun正在研究一种更复杂的自我监督学习,Marcus支持这种混合方法

最近一个获得关注的混合方法是神经符号人工智能,它是人工智能的一个分支,伴随着深度学习的兴起一度被淘汰它将人工神经网络与符号系统相结合,但将人类的专业知识提炼为一套规则,这被证明是非常困难,耗时且昂贵的,也被称为知识获取瓶颈虽然给数学或者逻辑写规则很简单,但是这个世界本身是很暧昧的事实证明,不可能为每种模式编写规则或为模糊概念定义符号

在3月份IBM Neurosymbol AI Symposium的一次演讲中,麻省理工学院计算认知科学教授约书亚·特南鲍姆解释了当前的神经符号系统如何帮助解决AI系统的一些关键问题,包括缺乏常识和因果关系,组合和直观物理。

我们如何超越智能的概念,即识别数据中的模式和近似函数,更多地走向人类思维对世界的建模——解释和理解你看到的东西,想象你看不到但可能发生的事情,并通过规划行动和解决问题将其转化为你可以实现的目标特南鲍姆认为,要弥合与人类智力的差距,首先要探索的是人类和许多动物共有的智力的基本方面之一:直觉物理学和心理学

Tenenbaum的神经符号AI概念的一个关键组成部分是物理模拟器,它被集成到智能体的推理过程中,以帮助AI实时模拟世界并预测未来将发生的事情。

由此可以大致了解目前神经符号系统AI的思路同时,该方法被证明比纯深度学习系统需要更少的数据和计算资源

这就引出了另一个问题——人工智能的范式转换马库斯下了新的赌注他认为我们中90%的人需要人工智能的范式转变,而SlateStarCodex的名人斯科特·亚历山大认为应该不到60%

勒村提出了争论的实质:情报是如何工作的是什么让人类独一无二

LeCun在文章中指出,马库斯对深度学习的批评源于认知科学中的一个相关斗争,即智能是如何产生的,是什么让人类独一无二他的想法与心理学中一个著名的先天论学派是一致的,该学派认为认知的许多关键特征是先天的——事实上,我们天生就有一个关于世界如何运作的直观模型,这在很大程度上是如此

这种与生俱来的建筑的一个核心特征是符号操作的能力但究竟是存在于整个自然界,还是人类独有,目前仍有争议对于马库斯来说,这种符号操纵能力是常识的许多基本特征的基础:遵循规则,抽象,因果推理,重新识别细节,概括等简而言之,我们对世界的认识大部分是大自然赋予的,学习是一个丰富细节的过程

另一种经验主义的观点认为,符号操纵在自然界中是罕见的,这主要是伴伴随着人类祖先在过去的两百万年中逐渐获得的学习和交流能力根据这一观点,认知能力主要是与提高存活率相关的非符号学习能力,如快速识别猎物,预测其可能的行为和发展熟练的反应这种观点认为,绝大多数复杂的认知能力是通过一种普遍的和自我监督的学习能力获得的这是通过经验获得直观世界模型的能力,具有常识的核心特征它还假设我们大多数复杂的认知能力不依赖于符号操纵,而是通过模拟各种场景和预测最佳结果来实现

这种经验主义观点将符号和符号操作视为另一种学习能力,这种能力是伴随着人类越来越依赖合作行为来取得成功而获得的这种观点将符号视为人类用来协调合作活动的发明——如文字,地图,图标描绘,仪式甚至社会角色这些能力被认为是由于青春期越来越长的学习时间和对更精确和专业技能的需求的结合这种观点认为,符号和符号运算主要归功于文化发明,较少依赖于大脑中的硬连线,更多依赖于我们日益复杂的社会生活

这两种观点的区别非常明显。

这种观点很有吸引力,可以解释进化适应衍生出的一系列能力

对于经验主义者来说,符号和符号推理是用于交流目的的有用发明,它源于一般的学习能力和复杂的社会世界这些象征性的东西,比如内心的计算,内心的独白,都发生在我们的头脑中,所以被视为源于数学和语言运用的外在实践

人工智能和认知科学是紧密相关的,所以这些争论被重复也就不足为奇了人工智能领域任何观点的成功,都会部分证明认知科学中这样或那样的方法是正确的,所以这些争论激烈也就不足为奇了现在,问题不仅在于人工智能的正确方法,还在于智能是什么,大脑是如何工作的

相比之下,如果深度学习的倡导者和经验主义者是正确的,那么插入符号操纵模块的想法是混乱的在这种情况下,深度学习系统已经在进行符号推理,并将继续改进它,因为它们通过更多的多模态自我监督学习,越来越有用的预测世界模型,用于模拟和评估结果的工作记忆的扩展来满足约束符号操纵模块的引入,并不会带来更像人类的AI,反而会通过一个不必要的瓶口强行进行所有的推理,让我们与类人智能渐行渐远这可能会切断深度学习最令人印象深刻的一个方面:它可以提出比人类程序员想象的更有用,更智能的解决方案

尽管事关重大,但同样重要的是,这些辩论中提出的许多问题至少在某种程度上是次要的比如一些讨论:深度学习系统中的高维向量应视为离散符号,实现深度学习系统所需的代码行是否使其成为混合系统,是否需要人工的,特定领域的知识才能在复杂的游戏中获胜,或者是否可以学习另一个问题是,混合系统是否有助于解决围绕人工智能的伦理问题

所有这些都不是为了证明这种愚蠢的宣传:当前的系统是无意识的——它们无法理解我们,强化学习也不够你不能仅仅通过扩大规模来构建人形智能但所有这些问题都与主要的争论无关:符号操纵需要硬编码吗,还是可以学习

这是呼吁停止研究混合模型吗当然不是自20世纪80年代以来,研究人员一直在研究混合模型,但它们尚未被证明是灵丹妙药——或者在许多情况下,甚至远不如神经网络更广泛地说,人们应该怀疑深度学习是否已经达到了极限

LeCun在最后写道,鉴于最近DALL—E 2,加托和PaLM中任务的持续和增量改进,避免将障碍误认为墙壁似乎是明智的深度学习不可避免的失败之前已经预料到了,但不值得为此打赌

郑重声明:此文内容为本网站转载企业宣传资讯,目的在于传播更多信息,与本站立场无关。仅供读者参考,并请自行核实相关内容。